2025年は、多くの企業が生成AIの動きを注視し、段階的に社内で使ってみるケースが増えてきた年だったのではないでしょうか。

今年の企業の動きや様々なレポートが出ており、この内容を分析しながら、当事務所が考える、ChatGPTなどの導入時のプロセスや経営者が持つべき思考法をご紹介したいと思います。

参考となる3つのレポート

まず今年(2025年)において、企業が生成AIを導入するにあたって参考になるレポートを3つご紹介します。

1. MIT:The GenAI Divide: State of AI in Business 2025

本レポートでは、生成AIの利用について二極化が進んでいるという内容からさらに進んで、95%の企業組織では、生成AIの活用によって何のリターンも得られていないという衝撃的な内容を公表したレポートになります。レポート原文はこちら

このレポートで注目したいのが、次の点になります。

① 問題はモデルの性能ではない

レポートでは、企業の生成AI活用の失敗理由をモデルの品質や法規制などといった要因ではなく、生成AI運用のフィードバックによる学習の欠如(運用改善のサイクルがない点)と、事業のワークフローへの統合不足(断片的な利用)を挙げています。

また、モデル関連では、5万ドル(700万円程度)を費やしたモデルより20ドルのChatGPTの方が優れたパフォーマンスを発揮するという、ChatGPTの即時的な使いやすさ・柔軟性・UXが自社開発などの他の生成AIサービスよりも優れているという報告も多く挙げられています。

会社指定の生成AIは使えないから使っていなかったり、会社の承認などを得ずにChatGPTなどを利用したりするなど、この問題は「シャドーAI」と言われる企業の情報管理にも発展する課題を含んでいます。

② 生成AI導入のROIは従業員削減よりもアウトソーシング削減

レポートでは、生成AIによる人員削減効果はさほど進まなかったことが報告される一方で、管理業務のアウトソーシング削減による費用削減効果が成功企業において顕著だった旨報告されています。

2. PwC:生成AIに関する実態調査 2025春 5カ国比較

本レポートは、日本・米国・英国・ドイツ・中国の5カ国を対象に、企業における生成AIの導入状況と活用成果を比較分析した調査レポートです。

MITのレポートと同様に、本レポートでも導入の進捗と実際の成果との間に大きなギャップが存在すること、特に日本企業においては生成AIを「導入しているが、十分な効果を実感できていない」状況が顕著であるという点が指摘されています。レポート原文はこちら

本レポートで注目したいのは次の点です。

①生成AI導入の成功企業はその要因としてユースケースとデータを挙げている

先ほどのMITのレポートと関連して、こちらでは、モデル性能に焦点をあてないのであれば、何が重要かという点を示唆しています。当事務所のセミナーでは生成AIの構造を、「入力(データ)×モデル(演算)×出力(課題解決)」という枠組みでご紹介させていただいております。この枠組みを使えば、多くの成功企業では、モデルではなく、入力データと出力の利用の設定が適切に行われている点が挙げられています。

②生成AIの企業活用環境整備が進んでいる

同様に本レポートでは、生成AI活用のための環境づくりとして、経営層による抜本的な活用(ワークフローへの統合)が見られ、これをサポートするために、CAIOやガバナンス体制の構築を本格的に行っていることが窺えます。

3. デジタル庁:生成AIの業務利用に関する技術検証、利用環境整備報告書

本報告書は、デジタル庁において生成AI利用環境「ELYZA App Platform」を2024年7月から提供し、職員による業務活用状況と専門家伴走支援の効果を検証するとともに、今後の行政における生成AI活用の課題と対応策を整理したものになります。報告書原文はこちら

本レポートでデジタル庁に提言された対応方針は次のようにされています。

①重要情報(機密情報)の取扱い可否が分水嶺

機密情報の取り扱いを可能にするために必要な条件・機能を具備した生成AI利用環境の整備が提言されており、その理由として、機密性2の情報を扱える環境を用意したところ、自発的な業務取り組みが進んだ点が指摘されています。言い換えると、「扱える情報の範囲の拡大」こそ活用加速の主要因だと分析されています。

②研修や勉強会を通した生成AIのユースケース教育の重要性

生成AIをどのように使えばよいか分からないという環境に対して、具体的なユースケースと留意点を学ぶ場の必要性が提言されています。

③COE(専門家のサポート)組織の発足の必要性

COE(専門家のサポート)組織の発足は、「知見者による支援をいつでも受けられる仕組み」を作ることで、現場だけでは解決しづらい生成AI活用の課題(試行錯誤のやり方が分からない、評価・改善の進め方が分からない等)を継続的に解消し、業務への組み込みを全庁的に加速させるために重要だと位置づけられています。

まとめ:3つのレポートが示すこと

これらのレポートが示すことは、生成AIの企業導入においては、モデルの性能などよりも、生成AIをどのように使うのかというユースケースの設定が重要であり、ユースケースも断片的なものではなく、抜本的なワークフローへの統合がより好ましいということが示唆されています。

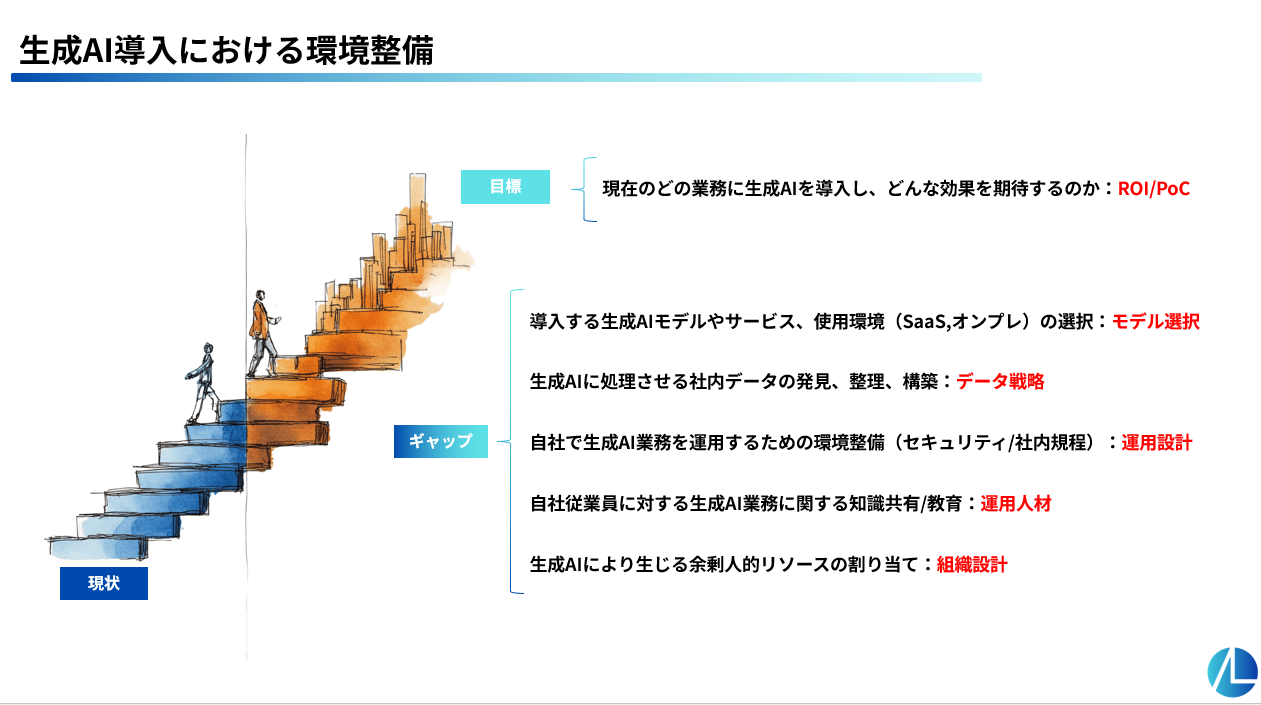

「ワークフローへの統合」をキーワードに考えるとすれば、事業プロセスの中に生成AIの機能を組み込もうとすれば、事業に密接に関連する情報を生成AIの演算(入力)に回さざるを得ません。

生成AI分野に注力する法律事務所や弁護士の真価の発揮どころだと思われます。というのもこのような事業関連データは、何らかの法的な権利義務が付着していることが多く、そのようなデータの取扱いについて法的な整理が必要だからです。

次に、「ワークフローへの統合」という抜本的な生成AI活用が成功のファクターとなっている一方で、失敗企業では断片的な生成AI活用が見受けられるというデータが挙がっています。

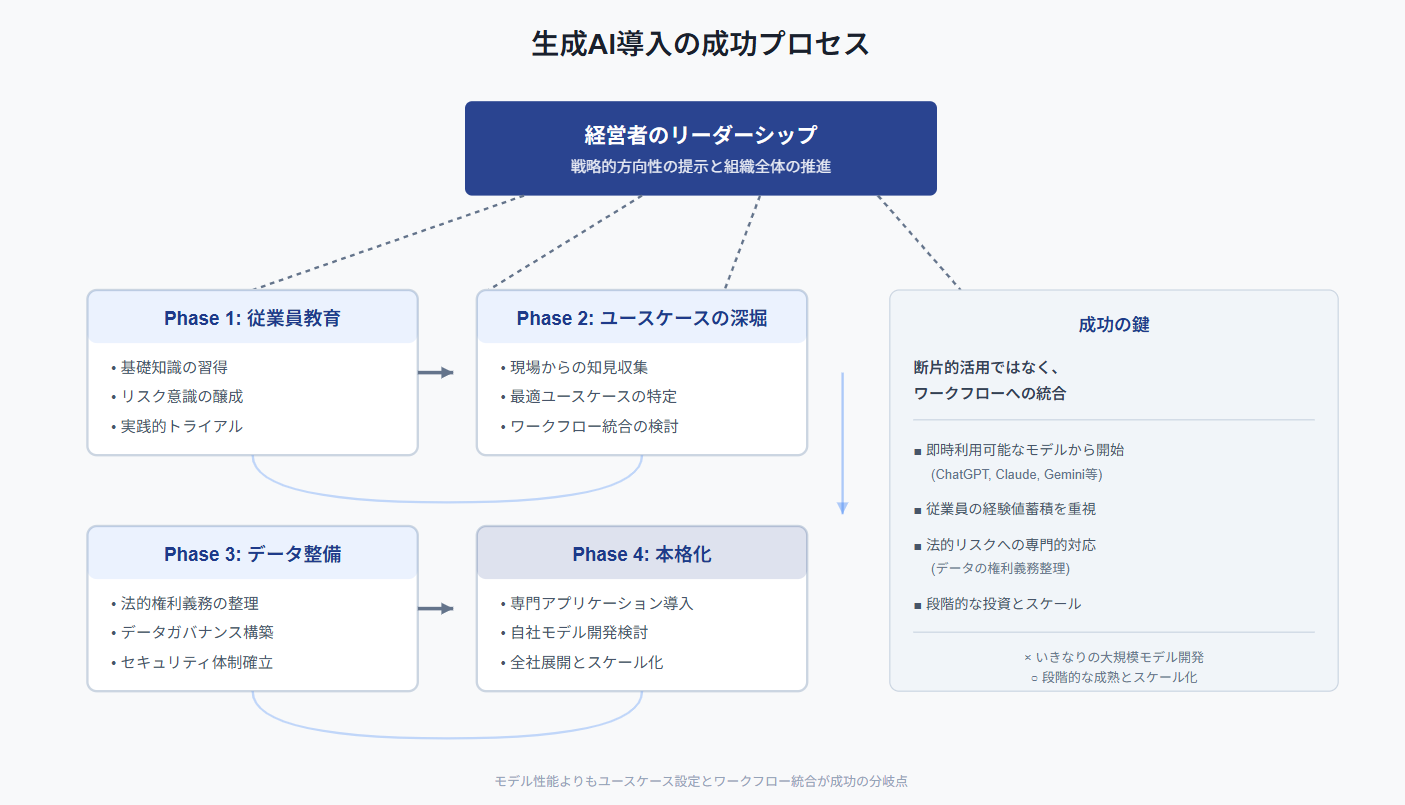

筆者としては、これは2極化というよりも、ユースケース設定の文脈から考察しており、企業としては、いきなり大規模な自社モデル開発などを行うのではなく、ChatGPTやClaude、Geminiに見られるような、即時的な使い方が可能なモデルから活用を始めて、従業員の生成AI活用方法から経験値を得ながら、自社にとって最適なユースケースを発見し、その後の本格化の段階で専門的なアプリケーションやサービスに移行する方法が示唆されているように思われます。そのプロセスにおいて、従業員に対して、生成AIの基本的な知識や様々なトライをしてもらう上で、最低限身に着けるべきリスク意識やタブーを専門家の力を借りながら社内に普及させる必要があるように思います。

経営者がリーダーシップをとるために設計すべきChatGPT導入計画

では、生成AIを導入しようとする企業において、経営者の目線からどのような導入計画を持つべきなのかを考えてみたいと思います。

経営者の役割は、具体的なモデルの選定や設計を行うことではなく、レポートが示す通り、個々の従業員からは発案しにくい「生成AIを自社事業のワークフローへ統合させる」ことを試みるという意思決定を行うことだといえます。

【参考:先行企業の取り組み例/経営者のトップダウン事例】

DeNAが挑む「AIネイティブカンパニー」

数千兆のAI agentsが常時稼働する世界へ。孫正義 特別講演レポート

経営者側から、まずはChatGPTなどの汎用的な生成AIサービスで従業員に生成AIの活用を促し、「自社にとって最適なユースケースが何であるか」というフィードバックを吸い上げるような改革から実行していくなどが考えられます。

この段階で経営者が意識しておくべきポイントは以下のような点になります。

経営者自らが生成AIを主導的に導入する意思を表明する

PwCのレポートにあるように、「トップダウンの戦略的意思決定と推進体制の整備」が重要視されています。

これは、先に述べたとおり、順序として、「既存ワークフローへの統合」が主な成功要因であり、これを達成するためには、経営者レベルの意思決定により計画を立て、環境整備として、データ環境の整備(法規制対応含む。)、社内ガバナンスの整備という形でつながっていっているものと思われます。また、ワークフローへの統合であるため、単発的、断片的な出力利用ではなく、エージェント機能(MCP:Model Context Protocol)を用いた生成AI活用となる傾向がみられるものと推測されます。

*昨今話題になっていたり、レポートで多く触れられている「エージェントとは何か」について補足します。

そもそもLLMと呼ばれるような生成AI自体(ChatGPT やClaude、Gemini)は本来、次の単語(トークン)を予測する、いわば「天気予報」のような過去から次の現象を予測するような働きを持つプログラムです。

そのため、LLM自体にwebを検索したり、他のアプリケーションを操作したりするという機能はついていません。そこで、OpenAIなどは生成AIがツールを使えるようにするために、様々な生成AIとツールとの接続技術を開発・実装してきました(webを検索するなどはその例)。この結果、生成AIは様々なツールを駆使して、ユーザーが求める出力を出すために、時にはwebを検索したり、アプリケーションに接続して必要な情報を収集したりするなど、あたかも自律的に(ツールという道具を自分で判断して利用したりするため)行動する機能が備わりました。

しかしそうすると、このようなツールとの接続方法が各社各様となり複雑化します。複雑化を避けるためにAnthropic社が生成AIとツール(アプリケーション)との接続方法について共通規格を提案しました。これがMCPです。これが2025年になり、様々なアプリケーション等に普及していったため、現在の生成AIサービスは多くのツールをより統一的に扱うことができるようになっています。

筆者としてはMCPの登場により、生成AIと様々なアプリケーション(Office 365やSlackなど)を組み合わせて使えるようになりましたが、特に2026年は各アプリケーションが自前となっているGoogleの各種アプリ×Geminiは注目を浴びるように思われます。おそらく、秘書のようにGeminiがGoogle カレンダーやGmailなどを操作して事務処理作業を行ってくれるようになってくるでしょう。

Anthropic社によるMCPの発表記事

話を戻すと、結局レポートで触れられているのは、このような「ツールを使う生成AI」を積極的に取り入れるべきであり、単に「天気予報機能」しか持たない生成AIではだめだという点が示唆されています。

経営者主導だからこそ生じる意思決定の責任関係

トップダウンによる経営者主導的だからこそ推進できる抜本的な生成AI利用を念頭とする意思決定が求められるわけですが、ただ生成AIを導入する旨表明すればいいというわけではなく、会社法上の善管注意義務(会社法330条、402条3項など)や忠実義務(355条、419条2項)を踏まえた意思決定が求められます。

(株式会社と役員等との関係)

第330条 株式会社と役員及び会計監査人との関係は、委任に関する規定に従う。

(忠実義務)

第355条 取締役は、法令及び定款並びに株主総会の決議を遵守し、株式会社のため忠実にその職務を行わなければならない。

また、導入する生成AIサービスの規模や内容(本格的な自社専用開発モデル導入の場合など)によっては、取締役会決議事項となるケースもあり得なくはないところです。

(取締役会の権限等)

第362条

4 取締役会は、次に掲げる事項その他の重要な業務執行の決定を取締役に委任することができない。

6 取締役の職務の執行が法令及び定款に適合することを確保するための体制その他株式会社の業務並びに当該株式会社及びその子会社から成る企業集団の業務の適正を確保するために必要なものとして法務省令で定める体制の整備

会社法においては、クラウド(SaaS系の生成AIサービスなど)導入において、社内の重要な情報の処理や管理を外部に委託する場合には、内部統制システムの一内容を構成すると考えられるため、使用する生成AIサービスの利用規約や、情報管理体制リスク等といったセキュリティ項目については事前に把握しておくことが求められます。

OpenAI「セキュリティとプライバシーへのコミットメント」

セキュリティ項目については、ChatGPTなどのサービスにおいては第三者の報告書の利用が一般的です。SOC2報告書などが米国のサービスなどでは見受けられると思いますが、これは財務報告に関する内部統制のために使われていたSOC報告書をそれ以外の分野でも利用可能とするため、SOC1~3に分類されたものの1つになります。SOC2はシステムの可用性やセキュリティ等の項目に焦点が当たっています。

日本では「保証業務実務指針3850」がこれに相当するものとされています。

保証業務実務指針3850「情報セキュリティ等に関する受託業務のTrustに係る内部統制の保証報告書に関する実務指針」及びIT委員会研究報告第55号「保証業務実務指針3850「情報セキュリティ等に関する受託業務のTrustに係る内部統制の保証報告書に関する実務指針」に係るQ&A」の改正について

*会社法施行規則

第100条 法第三百六十二条第四項第六号に規定する法務省令で定める体制は、当該株式会社における次に掲げる体制とする。一 当該株式会社の取締役の職務の執行に係る情報の保存及び管理に関する体制

このように、経営者の生成AIサービス導入時の意思決定については、抜本的な導入を志向するが故に少なからず法的な項目を伴った意思決定が必要になってきます。

企業内における議論では、

- 生成AIの利用目的

- 生成AIの事業への導入分野(関連するデータ項目の整理:個人情報、企業秘密、著作権など)

- 管理責任者

などを合わせて議論し、議事録や、決議資料、検討資料等を保管しておくことが推奨されます。

まとめ

本稿では、2025年における企業の生成AI導入の実態を示す3つの主要レポートを通じて、生成AI活用の成功と失敗を分ける要因を分析してきました。95%の企業が十分な効果を得られていない現状がある一方で、成功企業に共通するのは「モデルの性能」ではなく「ワークフローへの統合」という視点です。経営者には、ChatGPTなどの汎用的な生成AIから段階的に導入を開始し、従業員のフィードバックを通じて最適なユースケースを発見するプロセスをリードすることが求められます。そして、その意思決定には会社法上の善管注意義務や内部統制システムの整備という法的責任が伴うことを理解しておく必要があります。生成AI導入は単なる技術導入ではなく、経営戦略そのものなのです。

次の記事

次回は、本稿で触れた「入力(データ)×モデル(演算)×出力(課題解決)」の枠組みのうち、成功の鍵となる「データ」と「モデル選定」について詳しく解説します。具体的には、企業が保有するデータの法的整理(個人情報、企業秘密、著作権等)、機密情報の取り扱い可否による活用範囲の違い、そして自社に最適なモデル(ChatGPT、Claude、Gemini等)の選定基準について、実務的な観点から掘り下げていきます。