社内で生成AI利用ガイドラインを策定するときに最低限入れるべき項目は?

生成AIの業務利用が急速に広がる中、社内ガイドラインの策定は「従業員に使わせない」ためのものではなく、「安全に使いこなす」ための基盤整備です。

特に中小企業では、過度に厳格なルールを設けるよりも、自社の実態とリスクに即した最低限のルールを明確にすることが重要になります。

以下では、生成AI利用ガイドラインに最低限盛り込むべき5つの項目と、その策定の順序を解説します。

なお、個々の法令リスクの詳細については、営業秘密・個人情報・著作権に関する解説記事も併せて参照すると理解が深まります。

自社の生成AIの使い方を整理する ― リスクの棚卸しとリスクベースアプローチ

ガイドライン策定の出発点は、「自社が生成AIを何に使っているか(使おうとしているか)」を把握することです。

目的を整理しないまま禁止事項だけを並べても、現場で形骸化しやすくなります。

まずは、以下の観点で利用実態・利用予定を洗い出します。

- どの部署が

- どの目的で

- どのようなデータを使い

- どの生成AIサービスを利用しているか

次に、それぞれの利用方法について、関連する法令リスクと生成AI特有のリスクを整理します。

主な関連法令には、著作権法、不正競争防止法(営業秘密)、民法上の守秘義務、個人情報保護法などがあります。

また、生成AI固有のリスクとしては、ハルシネーション(もっともらしい誤情報の生成)、入力情報が学習データに取り込まれることによる情報漏えいリスク、出力内容が第三者の著作権を侵害するリスクなどが挙げられます。

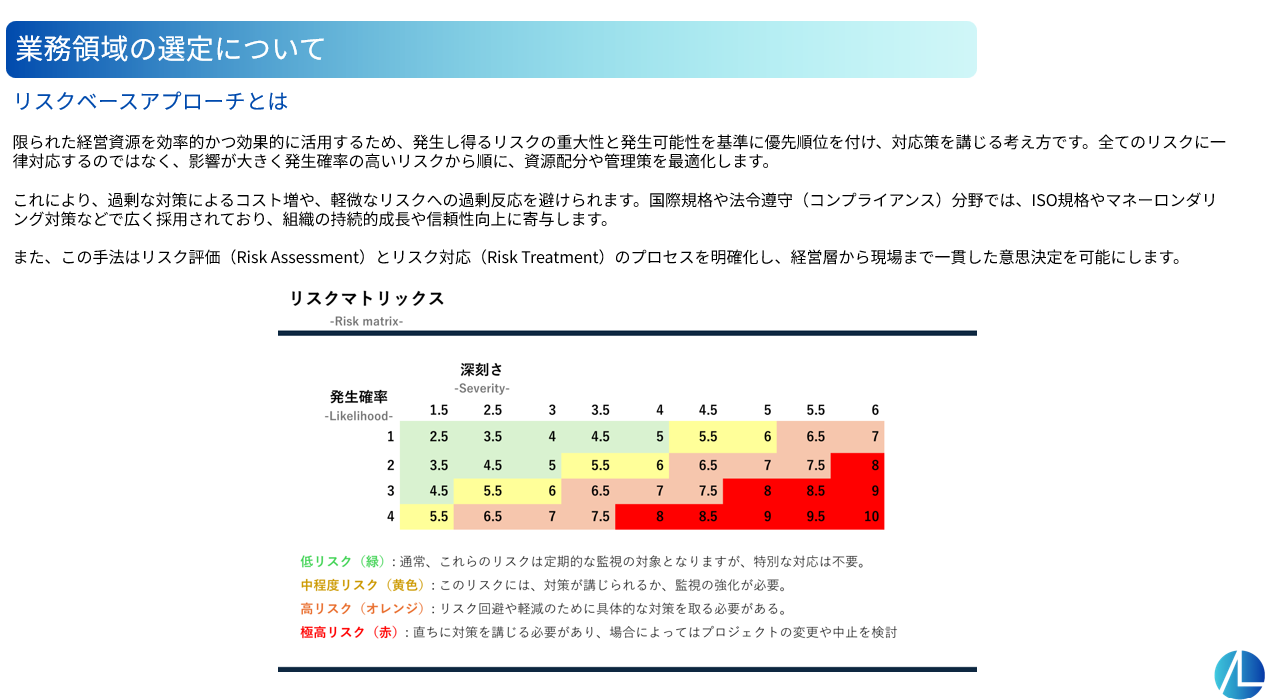

これらを踏まえ、発生可能性 × 影響度の観点でリスクレベルを評価する、いわゆるリスクベースアプローチを取ることが有効です。

参考として、EU AI規則(AI Act)附属書IIIに示されている高リスクAIシステムの用途(雇用・人事、信用評価、教育、法執行、重要インフラ等)に該当しないかをチェックすることも推奨されます。

この工程のゴールは、次の②で「何を禁止し、何を条件付きで許可するか」を判断するための材料をそろえることです。

禁止事項・許可条件の設定

①で整理したリスク評価をもとに、生成AIの利用ルールを具体化します。

すべてを一律に禁止するのではなく、リスクが高いものは禁止、管理可能なものは条件付きで許可することが現実的です。

禁止事項や利用条件を検討する際には、次の6つの軸が有用です。

- 使用可能な生成AIサービスの明記

会社が承認したサービスのみ利用可能とする - 使用可能なプランの明記

法人向けプラン(学習データへの取り込みがオプトアウトされているもの)に限定する - 使用可能なデータ範囲の明記

営業秘密、個人情報、未公開の契約情報などは入力禁止とする - 生成AIの機能の一部制限

ログが残らない一時チャット機能やウェブブラウジング機能の使用制限 - アクセス可能な端末・アカウントの明記

社内PC・社用アカウントに限定し、私物端末(BYOD)での利用は禁止 - 使用可能な人員の明記

所定の研修を修了した従業員に限るなど、③と連動させる

中リスク領域については、全面禁止ではなく「準禁止事項(条件付き許可)」とする方法もあります。

例えば、個人宛の文書作成では、氏名等の個人情報は入力せず、本文の一般的な表現のみを生成AIに作成させる場合に限り許可する、社外提出文書では生成AIの出力をそのまま使う場合に上長確認を必須とする、といったルールが考えられます。

また、原則として、生成AIの出力を対外文書や顧客向け文書、業務上の意思決定に用いる場合には、人による確認(Human-in-the-Loop)を経ることを定めておくことが重要です。

AI活用に関する民事責任に関しては、過失概念などと絡んで検討が進んでおり、このような動向を注視するとよいと思われます。

従業員の生成AIリテラシー向上(参考)

日本法上、現時点で従業員のAIリテラシー向上を直接義務付ける規制はありません。

しかし、②で定めた禁止事項・許可条件を実効的に機能させるためには、従業員の理解が不可欠であり、強く推奨される項目です。

EU AI規則では、AI提供者・利用者に対し、AIに関わるスタッフについて「十分なAIリテラシー」を確保する義務が課されています。

Living repository to foster learning and exchange on AI literacy

国内でも、AI事業者ガイドラインにおいて、各主体が必要なリテラシー確保措置を講じることが推奨されています。

研修内容としては、以下のようなものが考えられます。

- 生成AIの基本的な仕組みと限界(確率的出力、ハルシネーション)

- 社内ガイドラインの禁止事項・許可条件

- NG事例のケーススタディ(営業秘密の入力、著作権侵害の例)

- インシデント発生時の報告フロー

社内の生成AI組織体制

ガイドラインは策定して終わりではなく、継続的な見直しが前提となります。

そのため、PDCAサイクルを回すための社内体制を整備しておくことが重要です。

例えば次のような役割が期待されます。

- 生成AIガバナンス責任者:全体統括、法改正・技術動向の把握、ガイドライン更新判断

- 利用状況の監督者:各部署での利用実態の把握、ルール遵守の確認

- リテラシー向上の企画・実施者:研修の企画・実施・効果測定

- インシデント対応責任者:情報漏えい等の初動対応と再発防止策の策定

中小企業では、既存の情報セキュリティ委員会やコンプライアンス体制にAIガバナンス機能を追加する形でも問題ありません。

重要なのは、「誰が」「何を」担うのかを明文化し、責任や機能の所在を明確にすることです。

ログ・記録の保管

生成AIの利用実態を事後的に検証できる状態にしておくことは、インシデント対応やガイドライン改善の両面で不可欠です。

例えば、以下のような記録を保管します。

- 利用台帳(部署・サービス・利用目的)

- 判断記録(対外文書等に使用した際の確認者・修正内容)

- インシデント記録(違反内容、対応経緯、再発防止策)

- 研修記録(受講履歴、理解度テスト結果)

保管期間は、関連法令の時効期間等を参考に設定し、記録形式は後から検索・参照しやすい形で統一することが望ましいでしょう。